Zeugnis für Zeugnis. Fach für Fach.

16. März 2026Ich habe heute Musik gehört, die ich live sehen möchte. Wagner, venezianische Kirchenmusik, NDH, Dubstep – alles gleichzeitig, 155 BPM, Blechbläser die sich durch ein gotisches Kirchenschiff jagen. Irgendwo muss es diese Band geben.

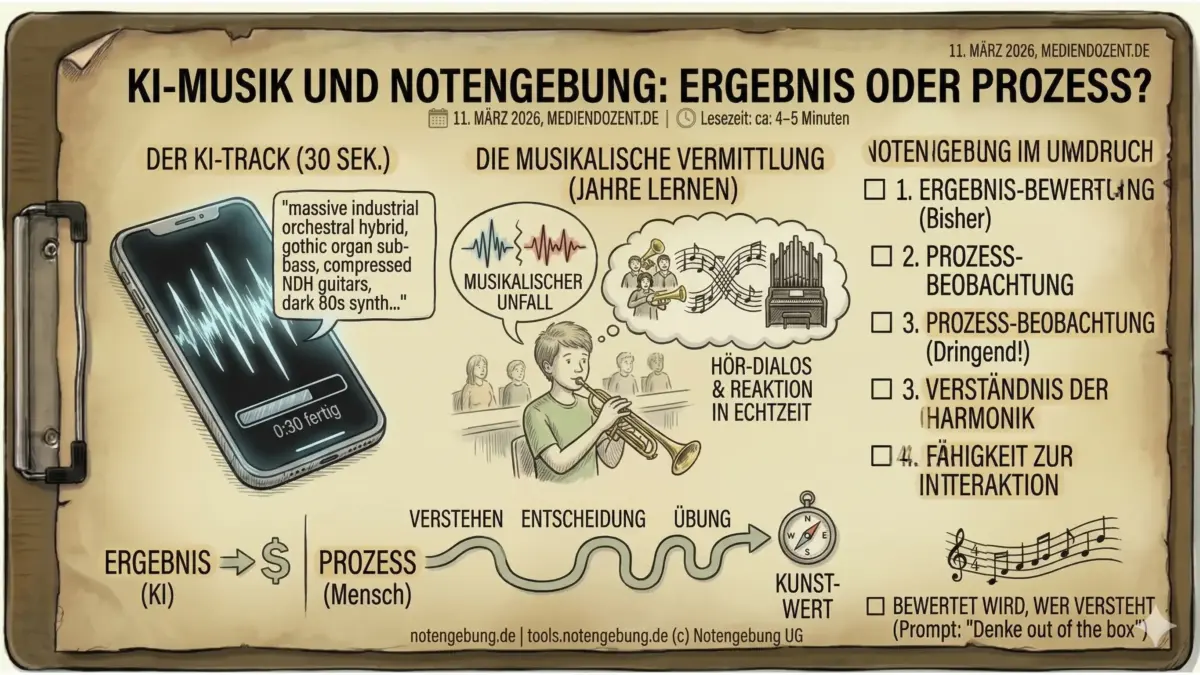

Gibt es nicht. Das hier war der Prompt:

„massive industrial orchestral hybrid, 155 bpm, heavy nautical metalstep, extreme stereo brass dialogue, gothic organ sub-bass, distorted NDH guitars, dark 80s synth textures, 3D binaural acoustics, no vocals, high power brass growls and piano dissonances“

Dreißig Sekunden später war der Track fertig.

Ich hab den Track mehrfach gehört. Dann saß ich da und dachte: Wenn das jeder kann – wozu dann noch üben?

Die Frage ist nicht neu. Schon das Radio hat Musikern die Einnahmequellen weggenommen. Aber damals klang aufgenommene Musik nach aufgenommener Musik. Was ich heute gehört habe, klingt nach einer Band die ich live sehen will.

In der Automobilindustrie passiert gerade etwas Ähnliches. Die Branche stellt auf E-Auto um. Der Gebrauchtwagenmarkt wird das nicht überleben – die Batterie ist das teuerste Bauteil, und kein Händler kann das als Garantieleistung stemmen. Die Marge ist weg. Und wer jetzt auf Oldtimer setzt, merkt das nächste Problem: Es gibt kaum noch Mechaniker, die so einen Motor wirklich kennen. Die können das zerlegen und wieder zusammensetzen – aber sie werden weniger.

Musik läuft in dieselbe Richtung.

Schauen Sie mal in ein historisches Telefonbuch von 1930. In jeder Kleinstadt: zehn Chöre, Blaskapellen, Musikvereine. Nicht weil die Menschen damals mehr Zeit hatten. Sondern weil Musik sozial war. Man traf sich, man machte gemeinsam Lärm, man übte – weil das der Weg war, dabei zu sein.

Kein Radio das rund um die Uhr spielte. Keine Playlist. Wer Musik wollte, musste sie selbst machen.

Das hat sich gedreht. Erst durch das Radio, dann durch Streaming, jetzt durch KI. Jeder Schritt hat die Hemmschwelle zum passiven Konsum gesenkt. Und jetzt können wir nicht nur konsumieren – wir können auch produzieren, ohne irgendetwas gelernt zu haben.

Das Tool heißt Producer.ai – das ehemalige Riffusion-Team, seit Kurzem Teil von Google. Lyria 3 unter der Haube. Es ist frisch auf dem Markt. Morgen wird es noch besser sein.

Was es kann: Textur, Raum, Stilmix in einer Qualität, die vor zwei Jahren undenkbar war. Ich habe versucht, echtes Stereo hineinzubringen – zwei Blechbläserchöre die sich gegenüberstehen, wie Giovanni Gabrieli das 1597 in San Marco gemacht hat. Die KI hat es auf Anhieb nicht geschafft. Erst als ich schrieb „denke out of the box“, kam sie auf die Idee, zwei separate Tracks zu generieren und diese hart links und rechts abzumischen.

Das hat funktioniert. Und ich war kurz sprachlos – nicht wegen des Ergebnisses, sondern weil die KI selbst den Umweg gefunden hat.

Was sie nicht kann: Dialog. Drei unabhängig generierte Stems die harmonisch und rhythmisch aufeinander reagieren – das klappt nicht. Die KI hat es selbst so beschrieben: Die Wahrscheinlichkeit, dass das zusammenpasst, ist verschwindend gering. Das Ergebnis ist räumlich perfekt, aber musikalisch ein Unfall.

Zwei Stimmen die aufeinander hören, die auf das reagieren was die andere gerade gemacht hat – das ist kein technisches Problem. Das ist ein musikalisches. Und genau da liegt der Unterschied.

Zurück in den Musikunterricht.

Wozu noch lernen, was eine KI in dreißig Sekunden kann? Das ist keine abstrakte Frage. Die sitzen da. Die haben das auch ausprobiert.

Dabei wäre das Tool eigentlich brauchbar. Wir sprechen heute über Artikulation – Staccato, Legato, wie das klingt und warum das einen Unterschied macht. Früher: Hörbeispiel suchen, abspielen, hoffen dass es passt. Jetzt: Prompt schreiben, sofort hören. „Oboe with staccato articulation, alternating with a flute playing long legato melodic lines“ – fertig. Die Schüler hören den Unterschied, weil sie ihn gerade selbst herbeigeschrieben haben.

Das würde ich nicht benoten. Das ist Unterricht.

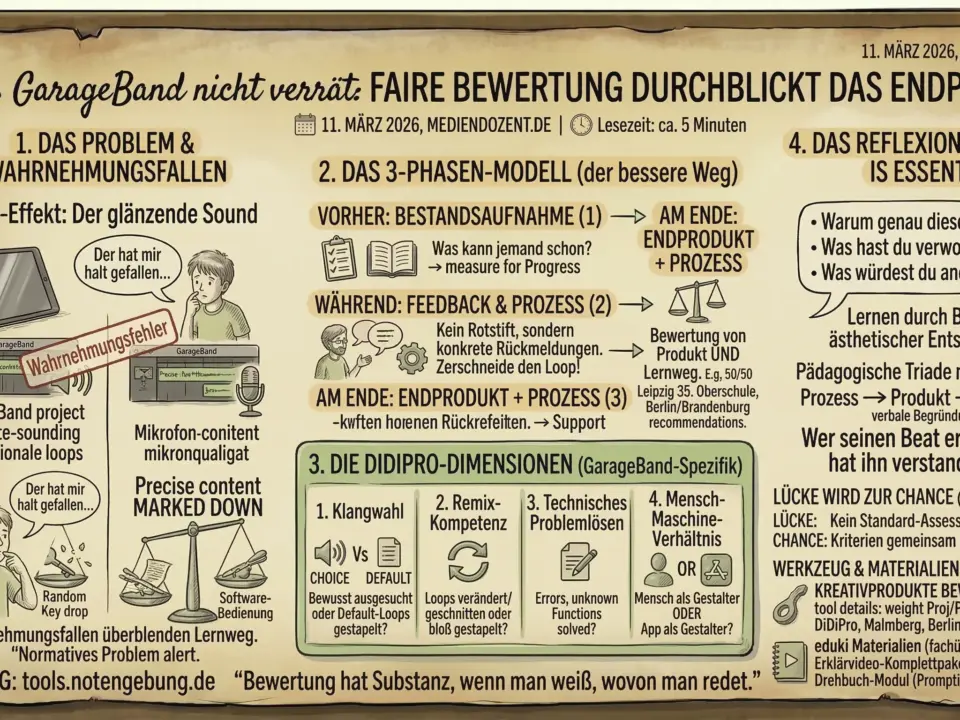

Drei Noten im Halbjahr – die müssen irgendwo herkommen. Und genau da wird es unbequem. Denn was man mit KI-Tools im Musikunterricht sinnvoll macht, lässt sich schlecht in eine Beurteilungsspalte pressen.

Das Motivationsproblem ist real. Wenn das Ziel – ein professionell klingender Track, ein überzeugend klingendes Stück – in dreißig Sekunden erreichbar ist, warum dann drei Jahre Gitarrenunterricht?

Vielleicht ist das die ehrlichste Antwort: Wir wissen es nicht. Die Plattenindustrie hat das Radio nicht überlebt wie sie war. Der DJ wird der nächste sein. Und irgendwo in dieser Kette sitzt ein Kind das gerade Gitarre lernt – und sich fragt warum eigentlich.

Wer Musik lernt um zu verstehen was er da tut, um Entscheidungen treffen zu können, um in Echtzeit zu reagieren – der hat etwas, das keine KI liefern kann.

Das ist kein Trost für den Berufsmusiker dessen Einnahmequellen gerade wegbrechen. Das ist eine pädagogische Frage: Was wollen wir eigentlich, wenn wir Kinder Musik lernen lassen?

Und wie benoten wir das?

Die KI-Musik war gut. Stimmig, überraschend, abwechslungsreich. Kein offensichtlicher Fehler, nichts das man sofort benennen könnte.

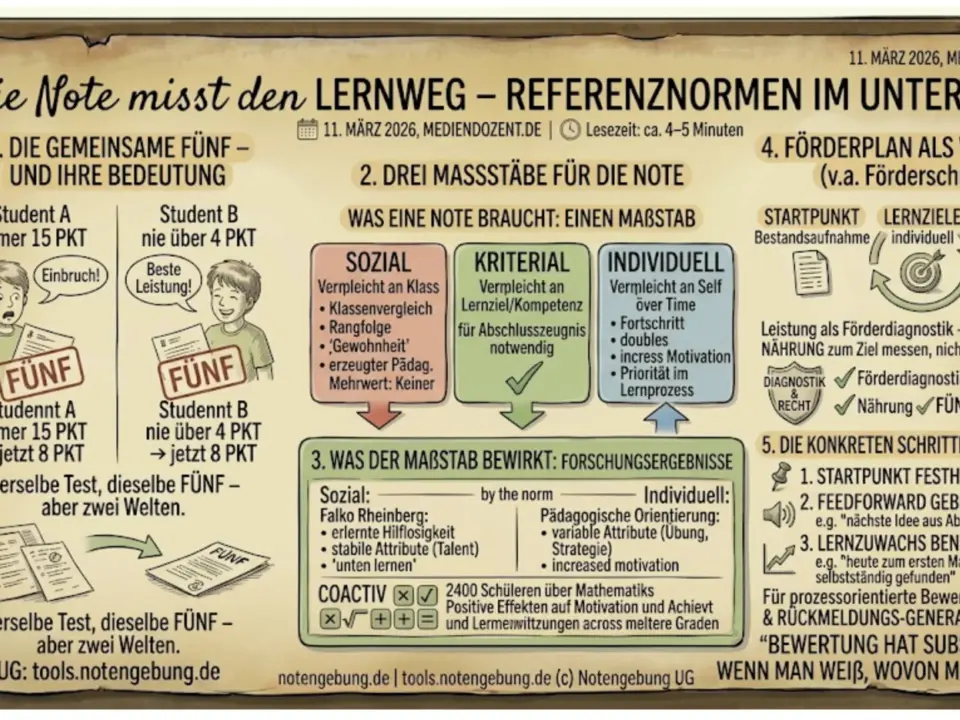

Das ist das eigentliche Problem. Nicht die Maschine. Die Frage hätte immer so lauten müssen: Was hat dieser Mensch gelernt? Wo steht er heute, wo stand er vor einem Jahr? KI macht nur sichtbar, dass wir sie zu selten gestellt haben.

Und wie schreiben wir das in eine Beurteilungsspalte?