Warum das Ergebnis allein keine faire Note ergibt

1. Februar 2026

Endlich Zeit zum beobachten

5. Februar 2026Lieber nur zuhören? Hier gibt es den Beitrag als mp3 Datei.

Lesezeit: ca. 7 Minuten

In meinem KI-Kurs für Lehrkräfte stellte eine Teilnehmerin eine Frage, die ich so nicht erwartet hatte. Sie hatte ChatGPT ausprobiert, ein paar Arbeitsblätter generiert – und war enttäuscht. Alles ähnlich. Alles irgendwie gleich. Lückentext, Multiple Choice, Fragen zum Text. Immer wieder.

„Warum macht die KI immer dasselbe?“

Mein erster Gedanke war: Weil du immer dieselbe Unterrichtsmethode verwendest.

Den konnte ich natürlich nicht so sagen. Also haben wir etwas anderes gemacht.

DeepResearch übernimmt das Unangenehme

Ich habe vorgeschlagen, die Frage direkt an eine KI zu stellen – und zwar mit etwas mehr Tiefe. Wir haben gemeinsam einen DeepResearch-Prompt formuliert: Warum produziert ChatGPT bei Anfragen zu Unterrichtsmaterialien so oft dieselben Formate? Was steckt dahinter?

Die Antwort kam nach ein paar Minuten. Ausführlich, gut belegt, strukturiert.

Und sie sagte – sinngemäß – genau das, was ich nicht sagen konnte.

ChatGPT liefert, was es in Millionen von Unterrichtsmaterialien gelernt hat. Lückentext, Multiple Choice, Fragen zum Text. Das sind die häufigsten Formate im Trainingsmaterial. Wer also fragt „Erstelle ein Arbeitsblatt zu Photosynthese“, bekommt den statistischen Durchschnitt des bisherigen Unterrichts. Methodisch unverdächtig. Pädagogisch mittelmäßig. Immer wieder.

Die KI spiegelt nicht unsere Kreativität zurück. Sie spiegelt unsere Gewohnheiten.

Das Werkzeug ist so gut wie die Methode dahinter

Das klingt nach Kritik an ChatGPT. Ist es aber nicht.

Ein Hammer baut kein Haus, wenn man nicht weiß wie man ihn hält. Und eine KI generiert keine methodisch vielfältigen Materialien, wenn der Prompt keinen methodischen Spielraum öffnet. Das ist keine Schwäche der Technologie – das ist eine Eigenschaft davon.

Der Prompt ist der Spiegel der Methode. Wer „Arbeitsblatt“ eintippt, bekommt ein Arbeitsblatt. Wer „Stationenlernen mit Reflexionsaufgabe und kooperativen Elementen“ eingibt, bekommt etwas anderes. Vielleicht nicht perfekt, aber deutlich interessanter.

Das Problem liegt selten im Werkzeug.

Methodenpool.de hat das vor zwanzig Jahren verstanden

Es gibt eine Seite die ich seit Jahren empfehle: methodenpool.de. Schlicht, damals noch nicht hübsch, kein Newsletter, kein Social Media. Aber dort stehen hunderte Methoden beschrieben, erprobt, kategorisiert. Wer sie kennt, hat einen anderen Ausgangspunkt – für den Unterricht und für den KI-Prompt.

KI kann nicht kompensieren was methodisch nicht da ist. Wer fünf Unterrichtsmethoden kennt, wird fünf Arten von Arbeitsblättern bekommen. Wer fünfzig kennt, hat plötzlich ganz andere Möglichkeiten.

Das ist kein Vorwurf. Im Schulalltag bleibt wenig Zeit für methodische Weiterbildung. Aber es ist eine ehrliche Diagnose.

Was ein guter Prompt tatsächlich leistet

Nach dem DeepResearch-Ergebnis haben wir nicht aufgehört. Ich habe mein Prompt-Plakat gezeigt – eine Übersicht die ich für genau solche Situationen entwickelt habe. Nicht zehn Regeln die man auswendig lernen muss, sondern eine visuelle Struktur die beim Formulieren hilft.

Was auf dem Plakat steht, lässt sich in einem Satz zusammenfassen: Kontext schlägt Befehl.

Wer der KI erklärt für wen das Material ist, in welcher Phase des Lernprozesses es eingesetzt wird, welches Ziel es verfolgt und welche Methode dahintersteckt – der bekommt etwas anderes als „Erstelle ein Arbeitsblatt“. Kein Geheimwissen. Aber auch nicht selbstverständlich.

Die Teilnehmerin hat ihren Prompt noch im Kurs umgeschrieben. Das Ergebnis war – ihr Zitat – „deutlich besser“.

Warum das für die Bewertung relevant ist

Wer jetzt denkt: schöner Prompting-Tipp, aber was hat das mit Notengebung zu tun? Berechtigte Frage.

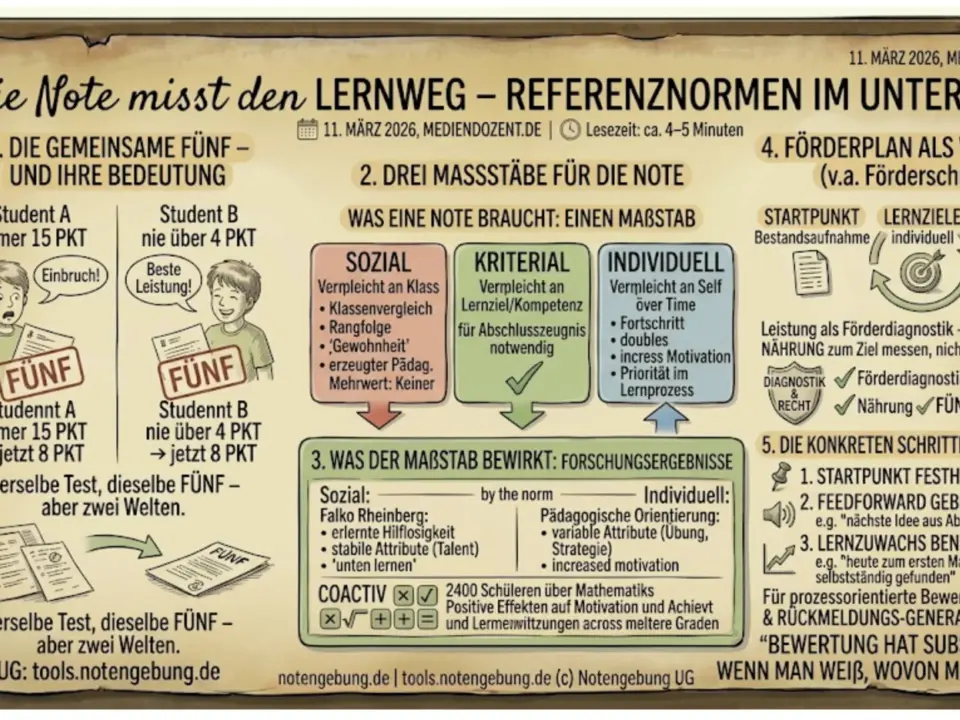

Methode und Bewertung hängen enger zusammen als es auf den ersten Blick scheint. Wer einen Lückentext ausfüllen lässt, bewertet Faktenwissen. Wer eine Reflexionsaufgabe stellt, bewertet Denkprozesse. Wer kollaboratives Arbeiten anlegt, bewertet Kommunikation und Zusammenarbeit.

Die Methode entscheidet was sichtbar wird. Und nur was sichtbar wird, kann bewertet werden.

KI-generierte Einheitsarbeitsblätter erzeugen KI-lösbare Aufgaben. Das ist kein Zufall – das ist eine logische Konsequenz. Wer diesen Kreislauf durchbrechen will, muss eine Ebene früher ansetzen: bei der Methode, nicht beim Detektor.

Was das konkret bedeutet

Der nächste Schritt muss kein großer sein. Methodenpool.de öffnen, eine unbekannte Methode anklicken, lesen. Dann: denselben Prompt wie immer formulieren – aber diesmal mit dem methodischen Rahmen als Zusatzinformation.

Das Ergebnis wird nicht perfekt sein. Aber es wird anders sein.

Und wer den nächsten Schritt gehen will – also nicht nur bessere Materialien generieren, sondern auch faire Bewertungsformate dazu entwickeln – der findet im nächsten Beitrag ein konkretes Werkzeug dafür. Kein Konzept, kein Framework. Ein Instrument das direkt im Unterricht einsetzbar ist.

Das Prompt-Plakat das im Kurs gezeigt wurde, ist auch auf eduki verfügbar – für alle die eine druckfertige Version für ihre Schule oder ihren eigenen Kurs brauchen.