Wer nicht beobachtet kann nicht beschreiben

9. März 2026

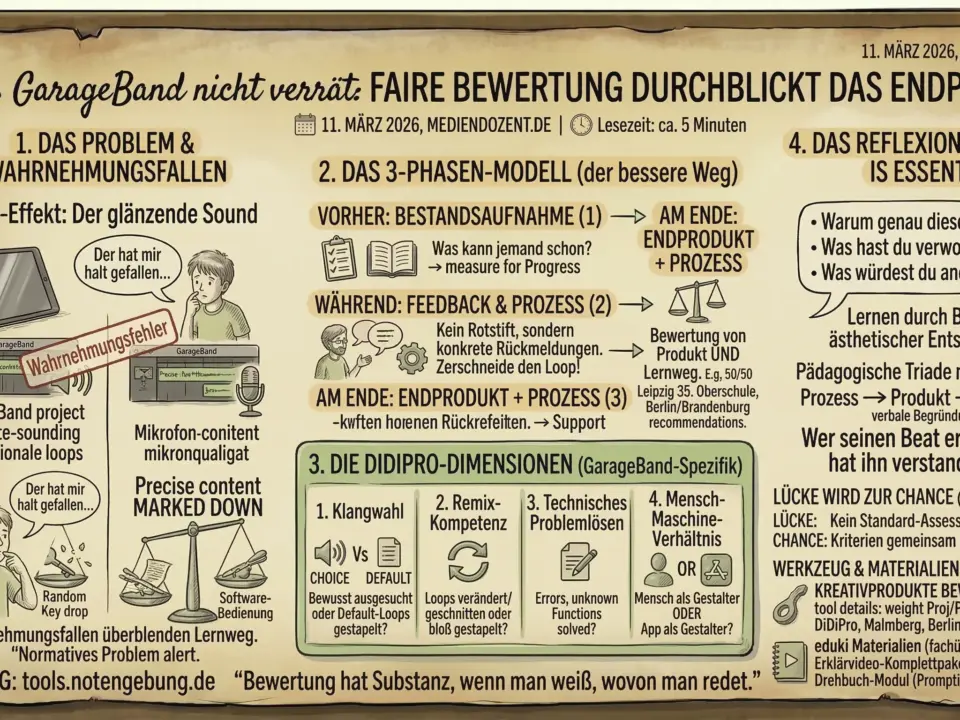

Was GarageBand nicht verrät – warum das Endprodukt beim Bewerten oft das falsche ist

11. März 2026Was kann das Tool?

Das Kreativprodukte-Bewertungstool erstellt druckfertige Bewertungsraster für digitale Schülerprodukte in vier Formaten:

- GarageBand-Remix / Musikproduktion – Klangwahl, Remix-Kompetenz, technisches Problemlösen, Mensch-Maschine-Verhältnis

- Podcast / Audio-Feature – Inhalt, Struktur, Sprache, technische Umsetzung

- Hörspiel – Dialog, Skript, Verständlichkeit, Geräuschgestaltung, Gruppenarbeit

- Erklärvideo – Zielgruppenadaption, Struktur, audiovisuelle Kohärenz, fachliche Richtigkeit

Für jedes Format gibt es drei Bewertungsdimensionen: Prozess, Produkt und Reflexion. Die Gewichtung lässt sich verschieben – wer nur das Endprodukt bewertet oder den Prozess stärker gewichtet, stellt das ein. Druckfertige A4-Ausgabe, kein Login, keine Daten verlassen den Browser.

Was soll es?

Für Podcasts und Erklärvideos gibt es brauchbare Bewertungsbögen – von mebis Bayern, dem Landesbildungsserver Baden-Württemberg, der Universität Bremen. Für GarageBand-Musikproduktionen im deutschsprachigen Raum: nichts. Kein einziges publiziertes Raster. Das Tool schließt diese Lücke. Es bringt die Forschungskriterien aus dem DiDiPro-Verbund und den Empfehlungen von Malmberg in ein Format, das im Schulalltag funktioniert – ohne Vorbereitungszeit, ohne Theoriekenntnisse.

Wo setze ich es ein?

| Situation | Geeignet? |

|---|---|

| GarageBand-Remix, Beat, Musikproduktion mit App | ✓ |

| Podcast oder Audio-Feature im Fachunterricht | ✓ |

| Hörspielproduktion (Grundschule und Sek I) | ✓ |

| Erklärvideo, Legevideo, Tutorial | ✓ |

| Klassenarbeit oder schriftliche Prüfung | ✗ (dafür gibt es den Notenschlüssel-Generator) |

| Gruppenarbeit mit Einzelbewertung | ✗ (dafür gibt es die Teambewertung) |

Dafür und dagegen

| Dafür | Dagegen |

|---|---|

| Einziges verfügbares Raster für GarageBand-Produktionen im deutschsprachigen Raum | Prozessdimension lässt sich nur bewerten, wenn Prozess auch beobachtet wurde |

| Drei Dimensionen (Prozess, Produkt, Reflexion) bilden den Lernweg ab, nicht nur das Ergebnis | Reflexionsgespräch kostet Unterrichtszeit – wer das nicht einplant, kann diese Dimension nicht fair bewerten |

| Gewichtung frei einstellbar – 50/50, 2/3 Produkt oder eigene Verteilung | Kriterien müssen vor der Aufgabe kommuniziert werden, sonst verlieren sie ihre Wirkung |

| Schützt vor dem Halo-Effekt: technische Brillanz zählt weniger als ästhetische Entscheidung | Nicht geeignet für sehr kurze Aufgaben ohne Planungsphase |

| Rechtlich abgesichert als „sonstige Leistung“ nach §48 SchulG NRW / Art. 52 BayEUG | |

| DSGVO-konform, keine Daten verlassen den Browser |

Vertiefung: Wissenschaftliche Grundlagen

Wir haben dieses Tool auf Basis folgender Erkenntnisse entwickelt:

Die Forschungslücke bei GarageBand

Eine systematische Recherche in Landesbildungsservern, Hochschulpublikationen und OER-Plattformen ergibt: Für Podcasts und Erklärvideos der Sekundarstufe existieren brauchbare Raster – mebis Bayern, der Landesbildungsserver Baden-Württemberg, die Universität Bremen haben gut dokumentierte Bögen veröffentlicht. Für GarageBand-Musikproduktionen, speziell für die Grundschule, gibt es im deutschsprachigen Raum kein einziges publiziertes Bewertungsraster. (Claude-Recherche notengebung.de, März 2026; Gemini-Recherche notengebung.de, März 2026)

DiDiPro: Vier Kriterien für digitale Musikproduktion

Der Verbund DiDiPro (Digitalität – Diversität – Producing) der Universitäten Oldenburg, Münster und Leuphana Lüneburg entwickelt evidenzbasierte Kriterien für das digitale Musik-Producing im Unterricht. Die vier Dimensionen: Klanggestaltung und auditive Differenzierungsfähigkeit (Sounds bewusst ausgewählt oder zufällig genommen?), Remix-Kompetenz (Loops verändert und kontextualisiert oder nur gestapelt?), technisches Problemlösen (eigenständiger Umgang mit Fehlern und unbekannten Funktionen), Mensch-Maschine-Verhältnis (intentionale ästhetische Entscheidungen oder App-Vorgabe übernommen?). (DiDiPro-Verbund, didipro.uol.de)

Malmberg: Prozess, Produkt, Präsentation – und 50/50

Isolde Malmberg (Universität Potsdam) empfiehlt für die Bewertung musikalischer Leistungen eine Triade aus Prozess, Produkt und Präsentation, ergänzt durch Peer-Feedback anhand gemeinsam entwickelter Kriterien. Ihre Empfehlung zur Gewichtung: 50/50 zwischen Peer-Einschätzung und Lehrkrafteinschätzung. Die 35. Oberschule in Leipzig setzt genau das um – Produkt und Prozess fließen zu gleichen Teilen in die Note ein. (Malmberg 2022, „Was ist eine musikalische Leistung?“, Friedrich Jahresheft; Oberschule Virchowstraße Leipzig, dokumentiert durch Universität Halle)

Das Berliner Drei-Phasen-Modell

Der Rahmenlehrplan Berlin-Brandenburg für Musik beschreibt drei Bewertungsphasen: Pre-Assessment vor der Arbeitsphase (individuelle Lernausgangslage erfassen), formatives Assessment während der Arbeitsphase (Feedback, kein Rotstift), summatives Assessment am Ende (Endprodukt plus Prozess). Nur wer weiß, wo jemand gestartet ist, kann den Lernfortschritt abbilden – nicht den Startpunkt mit Kapital im Rücken. (Rahmenlehrplan Berlin-Brandenburg, Fach Musik; LISUM Berlin-Brandenburg, Handreichung „Bewertung und Feedback im Fach Musik“ 2024)

Das Reflexionsgespräch als Bewertungsinstrument

Wer seinen Beat erklären kann – auch holprig, auch mit Pausen – hat sich damit auseinandergesetzt. Wer sagt „der hat mir halt gefallen“, hat zufällig etwas Gutes produziert. Niessen und Neuhaus haben empirisch gezeigt, dass tiefes Lernen erst durch die verbale Begründung ästhetischer Entscheidungen entsteht. Das Reflexionsgespräch macht die Blackbox des kreativen Prozesses evaluierbar: Wer hat gestaltet – die Person oder die App? (Niessen/Neuhaus, zitiert in: Bewertung digitaler Kreativprodukte, Gemini-Recherche 2026; Malmberg 2022)

Der Halo-Effekt und die sozioökonomische Täuschung

Ein Erklärvideo mit sauberen Übergängen wirkt besser als eines, das holprig klingt – auch wenn der Inhalt schlechter ist. Das ist der Halo-Effekt: ein auffälliges Merkmal überstrahlt alle anderen. Das Gegenteil funktioniert genauso: ein guter Podcast bekommt Abzug wegen schlechtem Mikrofon. Dazu kommt die sozioökonomische Täuschung: Wer zu Hause seit Jahren ein iPad hat, produziert in der ersten GarageBand-Stunde ein runderes Ergebnis als jemand, der die App vom Hörensagen kennt. Wer nur das finale Produkt normativ bewertet, bewertet am Ende das Elternhaus. (Bildungspakt Bayern, Leitfaden „Digitale Lernprodukte als Leistungsnachweise“, 2022, 25 Pilotschulen)

Das Tool löst folgende Probleme:

- Keine Vorlage für GarageBand-Bewertung im deutschsprachigen Raum

- Endprodukt-Bewertung, die den Lernweg unsichtbar macht

- Halo-Effekt durch technische Brillanz oder schlechtes Equipment

- Sozioökonomisch ungleiche Startpunkte, die als Leistungsunterschied erscheinen

- Fehlende Transparenz gegenüber Schülern, was überhaupt zählt

Weiterlesen: Was GarageBand nicht verrät – warum das Endprodukt beim Bewerten oft das falsche ist